Ghép mặt vào video người nổi tiếng, coi chừng hậu họa khó lường

Những ngày qua, nhiều đoạn video giả mạo sử dụng công nghệ Deepfake (tạm dịch là “Siêu làm giả”), ghép khuôn mặt của người này sang người khác với độ chân thật cao, đã xuất hiện tràn lan trên các trang mạng xã hội.

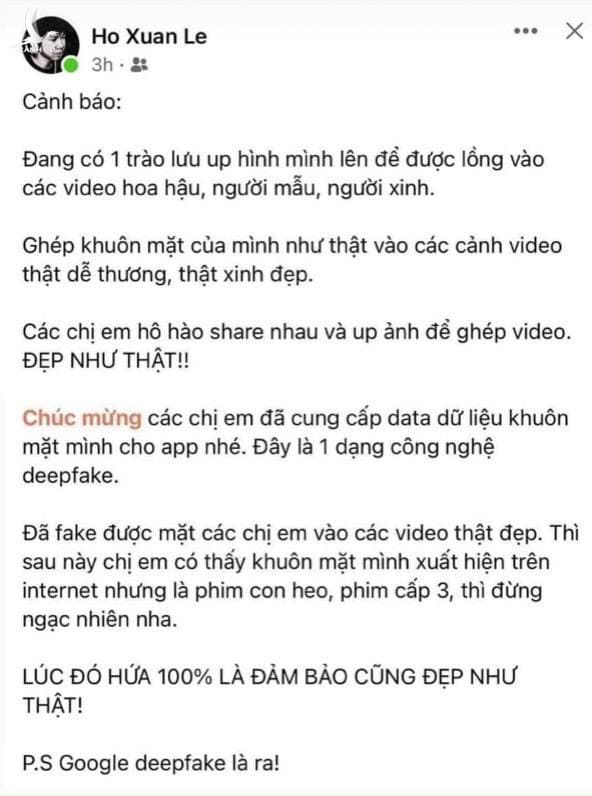

Hiện nay, trên kho ứng dụng điện thoại di động đang có rất nhiều ứng dụng công nghệ deepfake nhằm thay đổi khuôn mặt hoặc lấy ảnh của mình ghép vào video của người nổi tiếng. Mới đây nhất là trào lưu up hình mình lên ứng dụng để được lồng vào các video của hoa hậu, người mẫu, các video hài hước…

Trào lưu đang được phát triển rộng rãi nhất là phái nữ. Nhiều người đã chia sẻ vô tư hình ảnh của mình mà không mảy may do dự ?!

Hoán đổi khuôn mặt bằng ứng dụng Face Play

Hoán đổi khuôn mặt bằng ứng dụng Face Play đang là trào lưu được người dùng mạng xã hội Việt Nam hưởng ứng nhiệt tình.

Trào lưu ghép mặt vào các nhân vật nổi tiếng bất ngờ quay lại Việt Nam. Lần này, người dùng không chỉ chia sẻ những bức ảnh hoán đổi khuôn mặt, giới tính mà chuyển sang làm video bằng Face Play. Ứng dụng hoán đổi khuôn mặt bằng AI này đang đứng đầu danh sách ứng dụng đang thịnh hành trên hai kho App Store và CH Play.

Face Play hoạt động tương tự Reface – ứng dụng hoán đổi khuôn mặt từng gây bão toàn cầu. Tuy nhiên, Face Play chuyên về video ngắn.

Để dùng Face Play, người dùng chỉ cần chụp hình ảnh khuôn mặt theo góc trực diện hoặc tải ảnh từ điện thoại. Ứng dụng sẽ yêu cầu truy cập camera, kho hình ảnh và gửi thông báo. Nếu không đồng ý, người dùng sẽ không thể tiếp tục sử dụng.

Giao diện của ứng dụng khá đơn giản, từ màn hình chính, người dùng có thể xem trước video gốc. Những video có gắn icon hình kim cương trên góc trái sẽ tính phí, chỉ một số ít video được miễn phí. Một số video đặc biệt yêu cầu người dùng phải mua bằng tiền mã hoá tên Recharge. Giá của 60 coin tương ứng 20.000 đồng. Người dùng phải trả từ 19 coin để có thể dùng những video đặc biệt này. Kho nội dung trên Face Play khá phong phú, từ video thời trang, cổ trang, nhảy múa đến âm nhạc…. Sau khi chọn được video ưng ý, người dùng sẽ chọn ảnh khuôn mặt mình muốn hoán đổi vào video và chờ. Quá trình này diễn ra khoảng vài chục giây. Nếu dùng bản miễn phí, người dùng phải xem hết video quảng cáo mới có thể tải video về máy.

Vậy công nghệ deepfake nguy hiểm như thế nào?

Deepfake khai thác các bức ảnh và video của một người từ nhiều góc độ bằng cách sử dụng các mạng đối nghịch tổng quát (GAN), trong đó hai mô hình máy học (machine learning – ML) tấn công nó. Một mô hình ML đào tạo trên một tập dữ liệu và sau đó tạo ra các video giả mạo, trong khi các mô hình khác cố gắng phát hiện các giả mạo. Trình giả mạo tạo ra hàng giả cho đến khi mô hình ML khác không thể phát hiện giả mạo.

Và sau nhiều vòng phát hiện và cải tiến, deepfake đã hoàn thành. Tập dữ liệu huấn luyện càng lớn, người giả mạo càng dễ dàng tạo ra một deepfake đáng tin cậy. Đây là lý do tại sao video của các cựu tổng thống và những người nổi tiếng Hollywood thường được làm giả đầu tiên, bởi có rất nhiều cảnh quay video có sẵn công khai.

Ngày nay, bất cứ ai cũng có thể tải xuống phần mềm deepfake và tạo video giả thuyết phục trong thời gian rảnh rỗi. Thực tế là đã có nhiều khuôn mặt của những người nổi tiếng bị gắn lên cơ thể của các ngôi sao khiêu dâm hay khiến các chính trị gia nói những điều buồn cười.

Nhưng cũng thật dễ dàng để tạo ra một cảnh báo khẩn cấp về một cuộc tấn công sắp xảy ra, hoặc phá hủy cuộc hôn nhân của ai đó bằng một video sex giả, hoặc phá vỡ một cuộc bầu cử sắp tới bằng cách thả một video giả hoặc ghi âm thanh của một trong số các ứng cử viên ngày trước khi bỏ phiếu bắt đầu.

Đây mới chính là điều khiến nhiều người lo lắng, đến nỗi Marco Rubio, Thượng nghị sĩ đảng Cộng hòa, ứng cử viên tổng thống Mỹ năm 2016, ví chúng là tương đương với vũ khí hạt nhân.

Làm sao để phát hiện các video bị làm giả?

Phát hiện deepfake là một vấn đề khó khăn. Dĩ nhiên, những “con sâu không chuyên” có thể được phát hiện bằng mắt thường. Các dấu hiệu khác mà máy móc có thể phát hiện bao gồm thiếu chớp mắt hoặc bóng nhìn sai. Các GAN tạo ra deepfake đang trở nên tốt hơn mọi lúc, và chúng ta sẽ sớm phải dựa vào “pháp y kỹ thuật số” để phát hiện các deepfake.

Peter Singer, chiến lược gia về an ninh mạng và quốc phòng Mỹ, nói: “Việc phát hiện ra các video deepfake ngày càng khó hơn khi công nghệ trở nên tiên tiến hơn và video trông thực tế hơn”.

Còn ông John Villasenor, nghiên cứu viên quản trị cấp cao tại Trung tâm Đổi mới Công nghệ thuộc Viện Brookings, ở Washington khẳng định: “Mặc dù AI có thể được sử dụng để tạo ra các deepfake, nhưng cũng có thể được sử dụng để phát hiện ra chúng”. Song ông cũng cảnh báo rằng các kỹ thuật phát hiện thường bị tụt hậu so với các phương pháp tạo video deepfake tiên tiến nhất.

Hiện có nhiều nhà nghiên cứu tập trung vào phát hiện deepfake cũng như tìm cách đối phó. Facebook và Microsoft đã công bố một dự án trị giá 10 triệu USD tạo ra các video deepfake để giúp xây dựng hệ thống phát hiện.

Google đầu năm nay cũng đã phát hành một bộ dữ liệu giúp phát hiện âm thanh deepfake nhằm ngăn chặn các trường hợp như giám đốc điều hành gần đây ở Mỹ đã bị lừa chuyển hơn 200.000 USD cho một kẻ lừa đảo giả mạo giọng nói ông chủ của vị giám đốc này.

Song có lẽ cách tốt nhất để giảm thiểu tối đa khả năng bị làm giả danh tính là hãy bớt sống ảo.

Sơn Ca